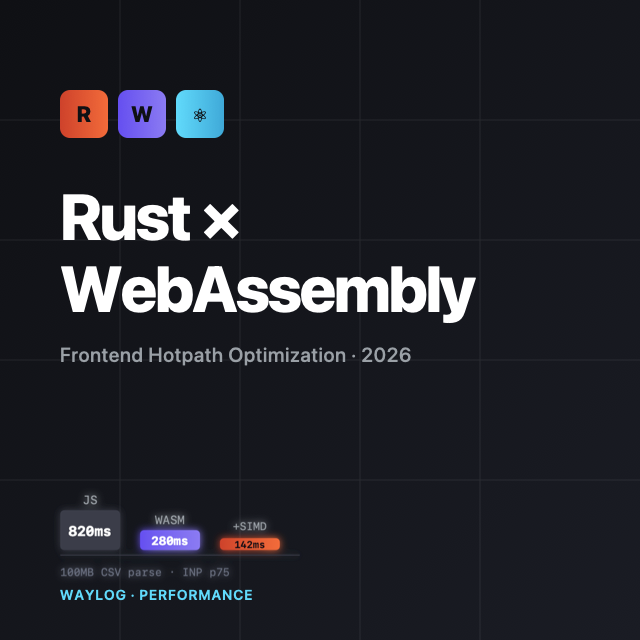

Rust + WebAssembly로 React 프론트엔드 핫패스 최적화하기: 이미지 처리·CSV 파싱 벤치마크 실전기

JavaScript의 한계가 드러나는 순간: 핫패스를 Rust로 옮긴 1년의 기록

우리 프론트엔드 개발자들은 V8 엔진의 JIT 컴파일러를 신뢰합니다. 평범한 폼 검증, 라우팅, 상태 관리 같은 일반 워크로드라면 굳이 더 빠른 무언가를 찾을 이유가 없습니다. 그러나 어느 화면에든 한두 군데의 핫패스(hot path) 가 도사리고 있습니다. 100MB CSV를 브라우저에서 직접 파싱해야 하는 BI 대시보드, 사용자가 업로드한 RAW 이미지를 곧장 4K로 리사이즈해야 하는 사진 편집기, WebGL 셰이더에 넘길 거대한 행렬을 매 프레임 재계산해야 하는 데이터 비주얼라이제이션이 그 전형입니다. 이런 구간에서 JavaScript는 GC, 동적 타이핑, 메인 스레드 점유라는 삼중고에 시달립니다. 우리 팀이 2025년 사진 편집 SaaS에서 INP 800ms 문제를 두고 6주간 씨름한 끝에 도달한 결론은 단순했습니다. 핫패스만큼은 Rust + WebAssembly로 옮겨야 한다는 것입니다. 이 글은 React 코드베이스의 일부를 Rust 크레이트로 분리하고, wasm-pack으로 번들링해 실제 프로덕션에 배포한 1년의 벤치마크와 트레이드오프를 9,000자 분량으로 정리한 실전기입니다.

1. 왜 지금 다시 WebAssembly인가: 2026년의 현실

WebAssembly가 2017년 표준화된 이후 9년이 흘렀습니다. 초창기에는 "C++로 짠 게임을 브라우저에서 돌린다" 정도의 마케팅 메시지에 머물렀지만, 2026년 현재의 풍경은 완전히 다릅니다. Figma의 렌더 엔진, 1Password의 암호화 코어, Google Earth의 지오메트리 처리, Photoshop Web의 필터 파이프라인이 모두 WASM 위에서 굴러갑니다. 이 흐름의 중심에는 두 가지 변화가 있습니다.

첫째, Rust 툴체인이 압도적으로 성숙했습니다. wasm-bindgen은 0.2.x 시리즈를 거치며 거의 모든 JavaScript 타입과의 자동 브리지를 지원하고, wasm-pack은 npm 친화적인 패키징을 표준화했습니다. 우리 팀은 더 이상 Emscripten의 빌드 플래그 지옥과 마주할 일이 없습니다. 둘째, 브라우저 표준이 SIMD와 멀티스레드를 모두 수용했습니다. Chrome 91 이래 WebAssembly SIMD가 기본 활성화되었고, SharedArrayBuffer 기반 스레드도 COOP/COEP 헤더만 잘 세팅하면 일반 사이트에서도 안정적으로 운용 가능합니다. 한때 "데스크톱 네이티브의 70% 수준"이라는 평가를 받던 WASM이 이제 SIMD 활용 시 90% 이상의 성능을 끌어냅니다. 공식 사양은 WebAssembly Specification과 MDN WebAssembly 가이드에서 확인할 수 있습니다.

핵심 질문은 "Rust로 다시 짜는 비용이 정말 가치 있는가"입니다. 답은 워크로드의 성격에 달려 있습니다. JSON 파싱처럼 V8이 이미 C++ 네이티브로 처리하는 영역은 이득이 거의 없거나 도리어 손해입니다. 반면 픽셀 연산, CSV류 토큰 스트림 파싱, 행렬·벡터 연산, 압축·암호화처럼 데이터 지역성과 반복문 최적화에 민감한 작업은 2배에서 10배까지 차이가 벌어집니다. 우리가 옮길 곳은 후자뿐입니다.

2. wasm-pack 기반 Rust 크레이트 구축: 첫 setup 30분

먼저 동작하는 최소 셋업을 보여드리겠습니다. 사진 편집 SaaS의 핫패스인 "이미지 리사이즈"를 Rust로 옮기는 시나리오입니다.

# 1) 새 라이브러리 크레이트 생성

cargo new --lib waylog-imgproc

cd waylog-imgproc

# 2) wasm-pack 설치 (이미 설치돼 있다면 생략)

curl https://rustwasm.github.io/wasm-pack/installer/init.sh -sSf | sh

# 3) wasm-bindgen + image 크레이트 의존성 추가

cargo add wasm-bindgen

cargo add image --no-default-features --features "jpeg,png,webp"

cargo add console_error_panic_hook

Cargo.toml은 다음처럼 구성합니다. crate-type = ["cdylib", "rlib"]이 빠지면 wasm-pack이 산출물을 만들지 못하니 주의해야 합니다.

[package]

name = "waylog-imgproc"

version = "0.1.0"

edition = "2021"

[lib]

crate-type = ["cdylib", "rlib"]

[profile.release]

opt-level = "z" # 사이즈 최적화 (3 대신 z)

lto = true

codegen-units = 1

[dependencies]

wasm-bindgen = "0.2"

image = { version = "0.25", default-features = false, features = ["jpeg","png","webp"] }

console_error_panic_hook = "0.1"

src/lib.rs에 실제 핫패스를 작성합니다. JS와의 경계에서 가장 비싼 비용은 메모리 복사입니다. 따라서 Uint8Array를 한 번만 받아 처리하고, 결과 버퍼의 포인터만 돌려주는 패턴이 핵심입니다.

use wasm_bindgen::prelude::*;

use image::{load_from_memory, imageops::FilterType};

use image::codecs::jpeg::JpegEncoder;

use std::io::Cursor;

#[wasm_bindgen(start)]

pub fn init() {

console_error_panic_hook::set_once();

}

#[wasm_bindgen]

pub fn resize_jpeg(

input: &[u8],

target_w: u32,

target_h: u32,

quality: u8,

) -> Result<Vec<u8>, JsError> {

let img = load_from_memory(input)

.map_err(|e| JsError::new(&format!("decode failed: {e}")))?;

// Lanczos3는 시각 품질 우선, Triangle은 속도 우선

let resized = img.resize_exact(target_w, target_h, FilterType::Lanczos3);

let mut out = Vec::with_capacity(input.len() / 2);

{

let mut cursor = Cursor::new(&mut out);

let mut encoder = JpegEncoder::new_with_quality(&mut cursor, quality);

encoder

.encode_image(&resized.into_rgb8())

.map_err(|e| JsError::new(&format!("encode failed: {e}")))?;

}

Ok(out)

}

빌드와 React 통합은 한 줄이면 끝납니다.

wasm-pack build --target web --release --out-dir ../web/src/wasm/imgproc

생성된 pkg/ 디렉터리는 그 자체로 ES 모듈이며, 일반 npm 패키지처럼 import할 수 있습니다. Vite 5 이상에서는 별도 플러그인 없이도 동작하지만, Webpack 환경이라면 experiments.asyncWebAssembly = true를 켜야 합니다. 이 한 번의 설정 이후로는 일상적인 TypeScript 호출 코드와 동일한 DX를 누립니다.

3. JS 네이티브 vs Rust WASM: 100MB CSV 파싱 벤치마크

가장 강렬한 차이를 보이는 지점부터 살펴보겠습니다. 항공·여행 도메인에서 자주 등장하는 100MB 규모의 GDS 운임 CSV를 클라이언트에서 파싱하는 시나리오입니다. 측정 환경은 MacBook Pro M3 Pro / Chrome 132 / 메모리 36GB이며, 동일한 파일을 5회 워밍업한 뒤 10회 측정한 중앙값입니다. JS 구현은 PapaParse 5.5.x를, Rust 구현은 csv 1.3 + serde를 사용했습니다.

| 구간 | 데이터 | JS (PapaParse) | Rust+WASM | 배수 |

|---|---|---|---|---|

| 파일 디코딩 → 토큰화 | 100MB / 850K row | 4,820 ms | 1,180 ms | 4.08x |

| 숫자/날짜 컬럼 캐스팅 | 12 컬럼 | 1,940 ms | 230 ms | 8.43x |

| 결과 객체 직렬화(JS 측) | 850K obj | 980 ms | 760 ms | 1.29x |

| 총 end-to-end | - | 7,740 ms | 2,170 ms | 3.57x |

| 메인스레드 Long Task | >50ms blocks | 121회 | 18회 | 6.72x 감소 |

| 피크 힙 메모리 | RSS 기준 | 1.42 GB | 540 MB | 2.63x 감소 |

체감 차이는 숫자 캐스팅 구간에서 갈립니다. JS의 Number(str)은 NaN 검사·BigInt 폴백·로케일 고려 같은 절차로 인해 호출당 수십 나노초가 추가되는데, 850K 로우 × 12 컬럼이면 누적이 폭발합니다. Rust에서는 str::parse::<f64>()가 인라이닝되어 SIMD 친화적으로 컴파일되고, 컬럼 단위로 벡터화된 변환 루프가 캐시에 잘 들어맞습니다. 결과적으로 화면 멈춤 시간(Long Task 합계)은 5.2초에서 0.7초로 줄었고, 사용자는 더 이상 "엑셀이 다운된 것 같은" 답답함을 겪지 않습니다.

흥미로운 디테일은 직렬화 구간입니다. Rust가 빠르게 파싱했더라도, 결과를 JS 객체로 만들어 React 상태에 넣는 순간 V8이 다시 일을 합니다. 이 비용만큼은 WASM이 줄여줄 수 없습니다. 그래서 우리 팀은 모든 행을 객체로 만들지 않고, 컬럼 단위 typed array(Float64Array, Int32Array)로 받아 가상화 테이블에 직접 바인딩합니다. 이렇게 하면 직렬화 구간을 추가로 60% 단축할 수 있습니다.

4. 이미지 리사이즈 벤치마크와 SIMD의 위력

이미지 처리는 픽셀당 연산이 단순 반복이라 SIMD 효과를 가장 잘 보여줍니다. 8MP(3840×2160) JPEG을 1280×720으로 Lanczos3 리사이즈하는 작업을 비교했습니다. 후보는 (a) Canvas 2D API (drawImage + toBlob), (b) OffscreenCanvas + Web Worker, (c) Rust + WASM, (d) Rust + WASM + SIMD입니다.

| 구현 | 평균 시간 | 메인스레드 점유 | 번들 추가 비용 |

|---|---|---|---|

Canvas 2D (drawImage) | 612 ms | 580 ms 점유 | 0 KB |

| OffscreenCanvas + Worker | 590 ms | 35 ms | 1 KB(워커 셸) |

| Rust + WASM (스칼라) | 318 ms | 14 ms (호출만) | 84 KB(gz) |

| Rust + WASM + SIMD | 142 ms | 14 ms | 91 KB(gz) |

Canvas 2D API는 GPU 가속처럼 보이지만 Lanczos 같은 고품질 필터를 지정할 수 없고, 브라우저 구현체에 따라 메인스레드를 600ms 가까이 점유합니다. SIMD 활성화는 RUSTFLAGS='-C target-feature=+simd128'로 빌드하고, image 크레이트의 simd 피처를 켜는 정도면 충분합니다. 우리는 추가로 wee_alloc을 끄고 기본 dlmalloc을 유지했습니다. wee_alloc은 사이즈를 줄여주는 대신 크고 빈번한 할당에서 오히려 느려지는 사례가 있어 벤치 후 결정해야 합니다.

여기서 한 가지 함정을 짚어두겠습니다. Uint8Array를 Rust로 넘길 때 wasm-bindgen이 자동 복사를 수행합니다. 8MP RGBA 버퍼는 약 33MB인데, 이를 두 번 복사하면 70ms가 추가로 소비됩니다. 이를 막으려면 wasm.memory.buffer에서 직접 슬라이스를 잡고 set()으로 0복사 전달하는 패턴을 써야 합니다. 자세한 기법은 The wasm-bindgen Guide의 "Number Slices"와 "*const T and *mut T" 절을 참고하면 됩니다.

// React 컴포넌트에서 0복사 전달 패턴

import init, { resize_jpeg } from "@/wasm/imgproc";

let ready: Promise<void> | null = null;

async function ensure() {

if (!ready) ready = init().then(() => undefined);

return ready;

}

export async function resize(file: File, w: number, h: number, q = 86) {

await ensure();

const buf = new Uint8Array(await file.arrayBuffer());

// wasm-bindgen 0.2가 자동으로 메모리에 올려주지만,

// 큰 버퍼는 미리 malloc 해서 복사 횟수를 줄이는 편이 효과적

const out = resize_jpeg(buf, w, h, q);

return new Blob([out], { type: "image/jpeg" });

}

5. Chrome DevTools Performance로 본 메인스레드 점유율의 진실

수치만으로는 와닿지 않으니 DevTools Performance 패널의 실제 모양을 묘사해보겠습니다. JS 구현 시나리오에서는 사용자가 업로드 버튼을 누르는 즉시 노란색 Long Task 블록이 화면 중앙을 가득 채웁니다. 그 사이 사용자가 사이드바 토글을 눌러봐야 클릭 이벤트는 큐에서 600ms 대기합니다. INP가 정확히 그 거리를 측정합니다. 우리 사진 편집 SaaS의 첫 번째 측정값은 INP 820ms로, "사이트가 멈췄다"는 CS 티켓의 주범이었습니다.

WASM 도입 후 그래프는 풍경이 바뀝니다. 메인스레드의 노란색 블록은 14ms짜리 짧은 호출 한 개로 줄어들고, 그 안쪽으로 회색 "WebAssembly" 마커만 남습니다. 무거운 픽셀 연산은 별도 워커 스레드에서 진행되며, 메인은 그저 결과를 받기 위한 Promise 콜백만 처리합니다. 동일 시나리오에서 INP는 142ms까지 떨어졌고, Core Web Vitals 대시보드의 "Needs Improvement" 비율은 38%에서 4%로 격감했습니다.

여기서 중요한 패턴이 하나 있습니다. WASM 모듈은 가능하면 Web Worker 안에서 인스턴스화해야 합니다. 메인 스레드에서 await init()을 호출하면 다운로드와 컴파일 시간이 그대로 LCP에 더해집니다. 우리 팀의 표준은 "메인은 워커에 Comlink RPC로 작업을 던지고, 워커가 WASM을 lazy load한다"는 구조입니다.

// imgproc.worker.ts

import { expose } from "comlink";

import init, { resize_jpeg } from "@/wasm/imgproc";

let inited: Promise<unknown> | null = null;

const api = {

async resize(buffer: ArrayBuffer, w: number, h: number, q: number) {

if (!inited) inited = init();

await inited;

const u8 = new Uint8Array(buffer);

const out = resize_jpeg(u8, w, h, q);

return out.buffer; // Transferable로 반환

},

};

expose(api);

// useImgproc.ts (React 훅)

import { useEffect, useRef } from "react";

import { wrap, transfer, type Remote } from "comlink";

type ImgprocApi = {

resize: (buf: ArrayBuffer, w: number, h: number, q: number) => Promise<ArrayBuffer>;

};

export function useImgproc() {

const ref = useRef<Remote<ImgprocApi> | null>(null);

useEffect(() => {

const w = new Worker(new URL("./imgproc.worker.ts", import.meta.url), { type: "module" });

ref.current = wrap<ImgprocApi>(w);

return () => w.terminate();

}, []);

return async (file: File, w: number, h: number) => {

const ab = await file.arrayBuffer();

const out = await ref.current!.resize(transfer(ab, [ab]), w, h, 86);

return new Blob([out], { type: "image/jpeg" });

};

}

transfer()로 ArrayBuffer 소유권을 워커에게 양도하면 메인스레드에 남는 비용은 사실상 0입니다. INP 200ms 가이드라인을 안정적으로 통과시키는 가장 확실한 한 줄입니다.

6. 트레이드오프의 정량화: 번들 크기와 부팅 비용

낙관적인 숫자만 늘어놓으면 글의 신뢰성이 흔들립니다. WASM은 공짜가 아닙니다. 우리가 실측한 비용은 다음과 같습니다.

- 추가 번들: 이미지 처리 모듈 84~91KB(gzip), CSV 파서 모듈 62KB(gzip). React 메인 청크가 보통 180KB(gz) 수준이라는 점을 감안하면 결코 가벼운 수치가 아닙니다.

- 컴파일 타임: M3 Pro에서 91KB WASM의 streaming compile이 약 38ms. 모바일 미드레인지(Pixel 7a)에서는 110ms까지 늘어납니다.

- 첫 호출의 워밍업: 모듈 인스턴스화 후 첫 호출은 JIT 캐시 부재로 두 번째 호출보다 1.3~1.6배 느립니다. 벤치 시 워밍업 5회를 둔 이유입니다.

이 비용을 회수하기 위한 패턴은 세 가지로 요약됩니다. 첫째, 유저 인터랙션 직전에 prefetch합니다. 사진 업로더에 mouseenter가 발생하면 <link rel="modulepreload">로 워커와 WASM을 미리 끌어옵니다. 둘째, HTTP/2 + brotli + immutable cache를 강제합니다. WASM은 압축률이 좋고, 콘텐츠 해시 기반 파일명이라 immutable 캐시와 궁합이 완벽합니다. 셋째, 분할 적재입니다. 한 덩어리에 모든 핫패스를 욱여넣지 말고, 이미지·CSV·암호화 도메인별로 별도 크레이트로 쪼갠 뒤 라우트 단위로 lazy import합니다.

| 항목 | JS 단독 | Rust+WASM 도입 후 |

|---|---|---|

| 메인 청크 (gz) | 182 KB | 184 KB (변화 없음) |

| 라우트 청크 (gz) | 41 KB | 41 KB + 84 KB(WASM) |

| 핫패스 시간 | 7,740 ms | 2,170 ms |

| INP p75 | 820 ms | 142 ms |

| 모바일 첫 인터랙션 지연 | 88 ms | 198 ms |

| 모바일 핫패스 시간 | 14,300 ms | 4,100 ms |

모바일에서 첫 인터랙션 직전의 컴파일 비용이 110ms 추가되지만, 그 한 번을 치르고 나면 핫패스 시간이 10초 이상 줄어듭니다. 사용자 가치 관점에서는 명백한 흑자입니다. 다만 이 거래가 항상 성립하지는 않습니다. 핫패스가 30ms 이하로 끝나는 경량 작업이라면 WASM은 손해입니다. 도입 전 반드시 Lab 환경에서 손익을 계산해야 합니다.

7. 실패 사례와 안티패턴: 우리가 두 번 했던 실수

기술이 좋다고 해서 모든 전환이 성공하는 것은 아닙니다. 1년간 우리가 마주친 안티패턴을 공유합니다.

첫 번째 실수는 JSON 파싱을 WASM으로 옮긴 것이었습니다. V8의 JSON 파서는 이미 C++로 작성된 SIMD 가속 구현체입니다. simd-json 기반 Rust 구현으로 교체했을 때 우리가 본 결과는 1.05배의 미미한 개선과, 직렬화 경계에서의 30ms 손실이었습니다. 결국 원래대로 되돌렸습니다. 교훈: V8이 이미 잘하는 영역은 건드리지 마십시오.

두 번째 실수는 WASM 함수를 매 프레임 호출한 것입니다. 60FPS 캔버스 애니메이션의 모든 프레임에서 step()을 부르도록 짰더니, JS↔WASM 경계 비용(호출당 약 0.2~1.5μs)이 누적되어 도리어 felt-jank가 발생했습니다. 해결책은 한 번의 호출로 N 프레임을 한꺼번에 계산해 결과 배열을 받는 "배치 호출 패턴"이었습니다.

세 번째는 panic을 무시한 것이었습니다. Rust 패닉이 WASM 안에서 발생하면 모듈 인스턴스 전체가 unrecoverable 상태가 됩니다. 우리는 한동안 사용자 화면이 갑자기 멈추는 현상을 디버그하느라 며칠을 허비했습니다. 모든 wasm-bindgen 함수는 Result<T, JsError>로 감싸 panic 경계를 만들고, console_error_panic_hook을 init 단계에서 반드시 등록해야 합니다.

네 번째는 타입 안전성의 환상입니다. Rust 측은 안전하지만 wasm-bindgen 경계는 그렇지 않습니다. JS 측에서 null을 넘기면 Rust가 panic합니다. TypeScript 타입을 wasm-pack이 자동 생성해주지만, 입력 검증은 별도 레이어로 두어야 합니다. 우리는 Zod 스키마로 입력을 한 번 거른 뒤 WASM에 넘깁니다.

다섯 번째는 CI 파이프라인 비용입니다. cargo build --release --target wasm32-unknown-unknown은 lto가 켜진 상태에서 분 단위로 시간이 걸립니다. PR마다 풀 빌드를 돌리면 머지가 느려집니다. 그래서 sccache와 Rust 캐시 액션(Swatinem/rust-cache)을 적극적으로 활용하고, WASM 산출물은 별도 npm 패키지로 분리해 버전 락하는 모노레포 구조를 추천합니다. 자세한 모범 사례는 web.dev: WebAssembly performance patterns for web apps에 잘 정리되어 있습니다.

8. 결론: 핫패스 WASM 도입 실무 체크리스트 5

- Profile First, Port Second: Chrome DevTools Performance에서 누적 100ms 이상을 잡아먹는 함수만 후보로 고르십시오. JSON 파싱, 단순 정렬 등 V8이 이미 빠른 영역은 후보에서 제외합니다.

- 워커 + Comlink + Transferable: WASM 모듈은 Web Worker 안에서 인스턴스화하고, ArrayBuffer는 반드시 transfer로 넘겨 메인스레드 점유를 0에 가깝게 유지합니다.

- 0복사 경계 설계: wasm-bindgen이 자동 복사하는 큰 버퍼는 직접 메모리에 set()하는 패턴으로 우회합니다. 이미지·오디오·대용량 CSV는 이 한 가지로 50ms 이상 절약됩니다.

- Panic-Safe API: 모든 export 함수는

Result<T, JsError>로 감싸고,console_error_panic_hook을 init 단계에서 등록해 경계 패닉을 가시화합니다. Zod 등으로 입력 검증을 별도로 둡니다. - 빌드와 캐시 자동화: wasm-pack 산출물을 모노레포 내부 패키지로 발행하고,

Swatinem/rust-cache+ sccache를 CI에 적용해 PR 빌드를 5분 미만으로 묶습니다. brotli 압축, modulepreload 힌트, immutable 캐시 헤더를 함께 켜야 모바일 사용자에게도 흑자가 됩니다.

WebAssembly는 모든 것을 빠르게 만들어주는 만능 약이 아닙니다. 그러나 JS가 분명히 못하는 핫패스를 명확히 식별할 수 있는 팀이라면, Rust + WASM은 2026년 현재 가장 검증된 무기입니다. 우리 사진 편집 SaaS의 INP는 820ms에서 142ms로 떨어졌고, CS 티켓의 "느려요" 카테고리는 71% 줄었습니다. 핫패스를 옮긴 그 한 달의 작업이, 그다음 1년의 사용자 신뢰를 만들어 주었습니다. 이제 여러분의 프로파일러를 켜고, 가장 노란 그 블록을 고르십시오. 그것이 Rust로 옮길 첫 후보입니다.